目次

1. NVIDIAのAIハードウェアとビジネスモデル

NVIDIAのGPUが切り拓くAIの未来

現代のAI技術の進化において、NVIDIAは欠かせない存在としてその地位を確立しています。特に、ディープラーニングや機械学習といった高度なAIタスクを支えるための強力な計算資源として、NVIDIAのGPU(グラフィックス・プロセッシング・ユニット)は広く利用されています。GPUはもともとグラフィック処理を目的として開発されましたが、その並列処理能力の高さから、AIモデルのトレーニングや推論においても非常に効果的であることが証明されています。

NVIDIAのGPUは、膨大なデータセットを短時間で処理する能力を持ち、AIアルゴリズムの学習速度を飛躍的に向上させます。これにより、企業や研究機関はより迅速にAIソリューションを開発・導入することが可能となり、競争力の向上や新たなビジネスチャンスの創出に寄与しています。

圧倒的な市場シェアと技術力

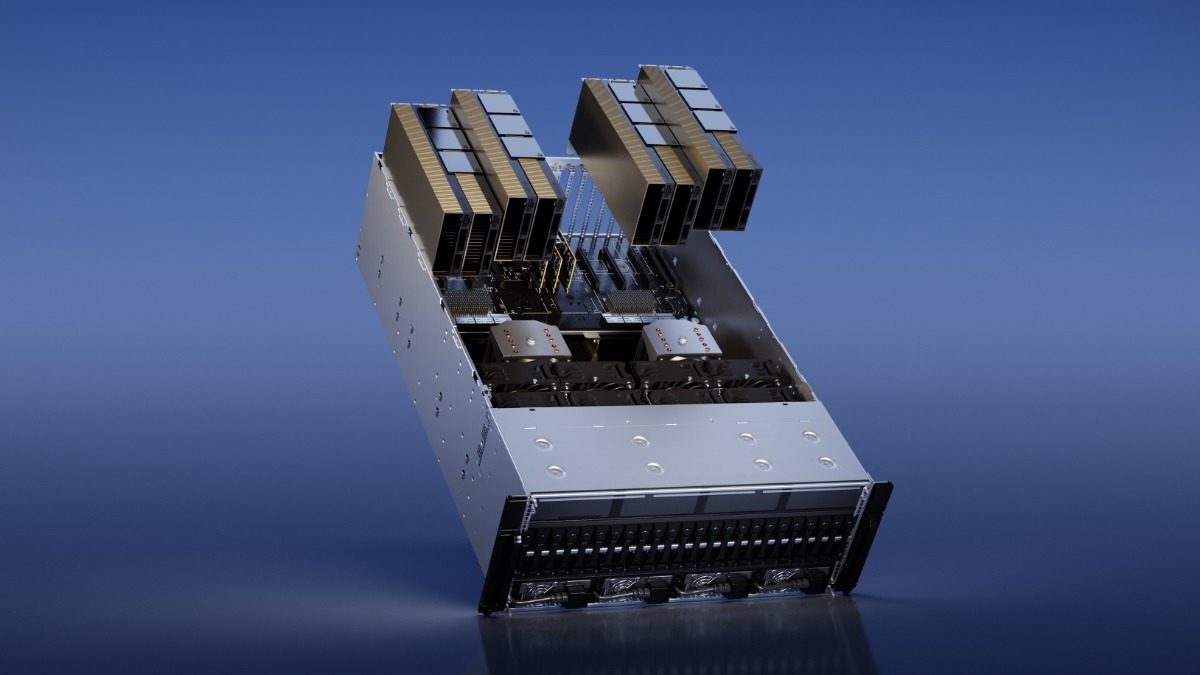

NVIDIAは、AI専用ハードウェア市場において圧倒的なシェアを誇っています。特に「H100」シリーズなどの最新GPUは、その高性能と信頼性から多くの企業や研究機関に採用されています。これらのGPUは、1モジュールあたり約500万円という高価格にもかかわらず、その性能から高いコストパフォーマンスを実現しており、長期的な投資としても魅力的です。

さらに、NVIDIAは継続的な技術革新を追求しており、毎年新しい世代のGPUを市場に投入しています。これにより、常に最新のAI技術に対応したハードウェアを提供し続けることで、業界内でのリーダーシップを維持しています。NVIDIAの技術力は、その高い計算能力だけでなく、エネルギー効率や耐久性など、多岐にわたる要素においても他社を凌駕しています。

CUDAプラットフォームの優位性

NVIDIAのもう一つの強みは、「CUDA(Compute Unified Device Architecture)」と呼ばれる独自の並列コンピューティングプラットフォームです。CUDAは、開発者がNVIDIAのGPUを最大限に活用できるよう設計されており、これにより複雑なAIアルゴリズムの効率的な実行が可能となります。

CUDA対応のソフトウェアは豊富に存在し、これがNVIDIAのGPUをAI開発の標準ツールとして位置付けています。開発者はCUDAを利用することで、GPUの並列処理能力を効果的に引き出し、AIモデルのトレーニング時間を大幅に短縮することができます。また、NVIDIAは定期的にCUDAのアップデートを行い、新機能や最適化を追加することで、常に最新の技術トレンドに対応しています。

水平分業とパートナーシップ

NVIDIAは、自社でGPUの設計を行う一方で、製造はTSMなど世界有数のファウンドリ企業に委託するという水平分業の戦略を採用しています。このアプローチにより、NVIDIAは最新の製造技術を迅速に取り入れることが可能となり、高品質なGPUを安定的に供給することができます。

さらに、NVIDIAは多くのテクノロジーパートナーと協力し、AIエコシステム全体の発展を支援しています。これにより、NVIDIAの技術はさまざまな産業分野で広く利用され、AI技術の普及と進化を加速させています。パートナーシップを通じて、NVIDIAは自社の技術を最大限に活用しつつ、他社の強みを取り入れることで、より包括的なAIソリューションを提供しています。

持続的なイノベーションへの投資

NVIDIAは、持続的なイノベーションを推進するために、年間売上の多くを研究開発に再投資しています。これにより、常に最新技術を取り入れた製品を市場に投入し続けることが可能となっています。例えば、最新のAIハードウェアは、前世代よりもさらに高性能であり、エネルギー効率も向上しています。これにより、AI技術の限界を押し広げ、新たな応用分野を開拓する基盤を提供しています。

2. ファウンデーションモデルの基礎と製造業への応用

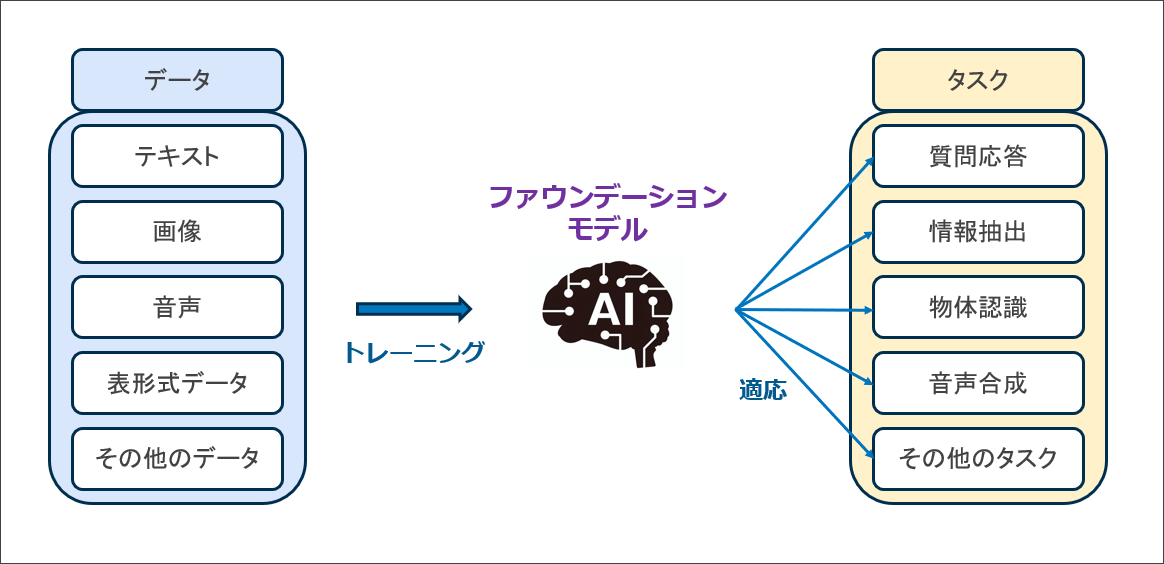

ファウンデーションモデルとは

ファウンデーションモデル(Foundation Model)は、広範なデータセットで事前に学習された大規模なAIモデルを指します。これらのモデルは、多様なタスクに適応可能な汎用性を持ち、特定の用途に合わせてさらに微調整(ファインチューニング)することで、さまざまな業界での具体的な問題解決に活用されています。ファウンデーションモデルは、自然言語処理(NLP)、画像認識、音声認識など、多岐にわたる分野で基盤となる技術を提供し、AI開発の効率化と成果の向上を実現しています。

製造業におけるファウンデーションモデルの必要性

製造業は、効率化と品質向上が常に求められる分野です。ファウンデーションモデルは、製造プロセスの最適化、予知保全、品質管理など、多くの側面で革新的なソリューションを提供します。例えば、AIを活用した生産ラインのモニタリングでは、ファウンデーションモデルが異常検知やパターン認識を行い、リアルタイムでの問題発見と対応を可能にします。これにより、ダウンタイムの削減や生産性の向上が実現され、企業全体の競争力が強化されます。

さらに、製造業におけるファウンデーションモデルの導入は、データ駆動型の意思決定を支える基盤となります。膨大な量のセンサーデータや運用データを効果的に分析し、洞察を引き出すことで、製品開発やプロセス改善においてより精度の高い判断が可能となります。これにより、製造業は市場の変動や顧客のニーズに迅速に対応し、持続的な成長を遂げることができます。

ファインチューニングとカスタマイズのプロセス

ファウンデーションモデルは、その汎用性ゆえに、特定の業務やニーズに合わせて最適化するためのファインチューニングが必要です。ファインチューニングとは、既存の大規模モデルを特定のデータセットやタスクに適応させるプロセスを指します。これにより、モデルは特定の業界や業務に対する理解を深め、より高精度な予測や判断を行うことが可能となります。

製造業におけるファインチューニングの具体例としては、以下のようなものがあります

-

予知保全モデルの構築

製造設備のセンサーデータを用いて、機器の故障予測モデルをファインチューニングします。これにより、故障の兆候を早期に検知し、計画的なメンテナンスを実施することで、突発的なダウンタイムを防ぐことができます。 -

品質管理モデルの最適化

製品の検査データを基に、欠陥検出モデルをファインチューニングします。これにより、製品の品質をリアルタイムで監視し、欠陥品の早期発見と排除を実現します。 -

生産ラインの最適化

生産プロセスのデータを活用して、プロセス最適化モデルをファインチューニングします。これにより、生産効率を最大化し、コスト削減と納期短縮を図ります。

ファインチューニングのプロセスは、以下のステップで進行します。

-

データ収集と準備

製造業特有のデータを収集し、モデルに適した形式に整えます。データの品質と多様性が、ファインチューニングの成果に大きく影響します。 -

モデル選定と初期設定

ファウンデーションモデルの中から、目的に最も適したモデルを選定し、初期設定を行います。NVIDIAのGPUを活用することで、大規模なデータ処理や高速なモデル学習が可能となります。 -

ファインチューニングの実施

特定のタスクに対してモデルを微調整します。この際、さくらインターネットのクラウドインフラを利用することで、スケーラブルかつ効率的なファインチューニングが実現します。 -

モデルの評価と改善

ファインチューニング後のモデルを評価し、必要に応じてさらなる調整を行います。これにより、モデルの精度と信頼性を向上させます。

3. 日本製造業におけるAI活用の現状と課題

日本企業のAI投資状況

日本の製造業は、長年にわたり高品質な製品と効率的な生産プロセスで世界をリードしてきました。しかし、グローバルな競争が激化する中、デジタルトランスフォーメーション(DX)の一環としてAI技術の導入が急務となっています。多くの日本企業がAIへの投資を増加させており、生産ラインの自動化、予知保全、品質管理など多岐にわたる分野でAI技術を活用しています。

例えば、自動車メーカーでは、製造プロセスの最適化や不良品の早期検出にAIを導入しています。電子機器メーカーでは、サプライチェーンの効率化や需要予測にAIを活用し、在庫管理や生産計画の精度を向上させています。また、重工業分野では、設備の異常検知やメンテナンススケジュールの最適化にAIを活用することで、稼働率の向上とコスト削減を実現しています。

しかしながら、日本企業のAI投資にはいくつかの課題も存在します。特に、中小企業においては、AI技術の導入に必要な専門知識や資金が不足していることが多く、導入のハードルが高いとされています。また、既存のシステムとの統合やデータの標準化が進んでおらず、効果的なAI活用が難しい状況です。

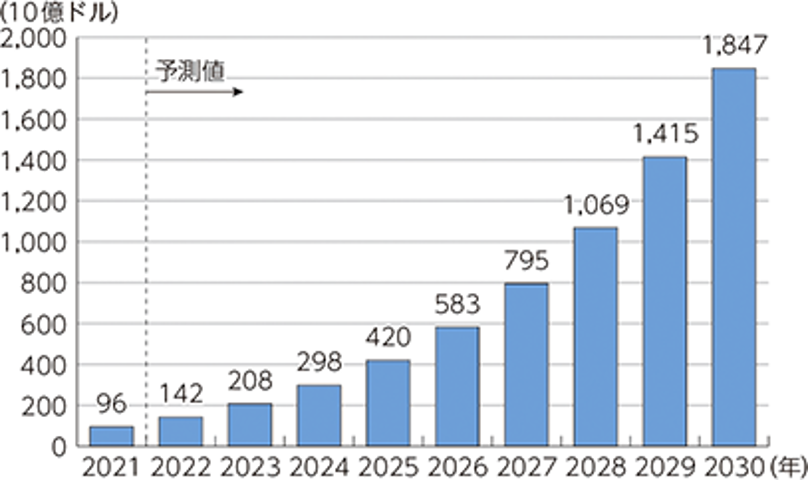

世界のAI市場規模(売上高)の推移及び予測

(出典)Next Move Strategy Consulting(Statistaより引用)

ファウンデーションモデルの普及と競争

ファウンデーションモデル(基盤モデル)は、製造業におけるAI活用の基礎となる重要な要素です。これらの大規模なAIモデルは、多様なデータセットで事前に学習されており、特定のタスクに合わせて微調整(ファインチューニング)することで、製造業のさまざまなニーズに対応可能です。

日本の製造業においても、ファウンデーションモデルの導入が進んでいます。例えば、品質管理では、画像認識技術を活用した不良品の自動検出にファウンデーションモデルが活用されています。また、予知保全では、機械のセンサーデータを解析し、故障の予兆を早期に発見するためにファウンデーションモデルが利用されています。

一方で、ファウンデーションモデルの普及には競争も伴っています。グローバルなテック企業や他のAIプロバイダーとの競争が激化する中、日本企業は独自のファウンデーションモデルの開発やカスタマイズに注力しています。特に、NVIDIAの高性能GPUとCUDAプラットフォームを活用することで、効率的なモデルの学習と運用が可能となり、競争力の向上につながっています。

さくらインターネットの取り組みとビジネスモデル

日本のAI活用を支える重要なプレイヤーとして、さくらインターネットがあります。さくらインターネットは、高信頼性なクラウドサービスを提供し、製造業向けのAI基盤の構築を支援しています。同社は、NVIDIAのAIハードウェアを活用し、強力な計算リソースを提供することで、製造業におけるAIプロジェクトの成功をサポートしています。

AI基盤の構築とサーバー提供

さくらインターネットは、NVIDIAのH100などの高性能GPUを搭載したAIサーバーを提供しています。これにより、企業は大規模なデータセットの処理や複雑なAIモデルのトレーニングを効率的に行うことができます。また、さくらインターネットのクラウドインフラは、スケーラビリティと信頼性に優れており、企業のニーズに応じた柔軟なリソース提供が可能です。

ビジネスモデルの詳細

さくらインターネットのビジネスモデルは、AIサーバーのレンタルとクラウドサービスの提供に基づいています。企業は必要な時に必要なだけの計算リソースを利用できるため、初期投資を抑えつつ高性能なAI環境を構築することができます。また、さくらインターネットは、AIモデルのファインチューニングやカスタマイズに必要なサポートも提供しており、企業のAI導入を全面的に支援しています。

さらに、さくらインターネットは、セキュリティ面でも強固な対策を講じています。データの暗号化やアクセス制御、多層防御などを実装し、企業の機密情報を保護しています。これにより、製造業におけるAI活用の際に安心してデータを扱うことができます。

4. AIハードウェアのコスト構造と競争環境

高価なAIハードウェア(H100など)の課題

AI技術の進展に伴い、企業は高度なAIモデルの構築や運用に必要なハードウェアへの投資を増加させています。特にNVIDIAの「H100」シリーズは、その卓越した性能から多くの企業に採用されています。しかし、これらのAIハードウェアにはいくつかの課題が存在します。

まず、高コストが大きな障壁となっています。H100 GPUは1モジュールあたり約500万円という高価格設定であり、中小企業にとっては導入が難しい場合があります。この高価格は、最新の技術を搭載しているために避けられない部分もありますが、企業の初期投資を大きく押し上げる要因となっています。

さらに、電力消費と冷却の問題も無視できません。高性能なGPUは大量の電力を消費し、発熱も大きいため、効率的な冷却システムが必要です。これにより、運用コストがさらに増加し、持続可能なAI環境の構築が難しくなる場合があります。

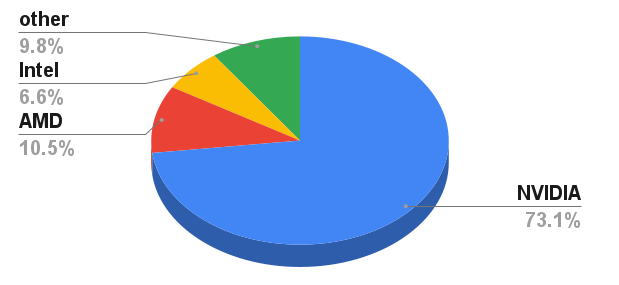

画像引用:PC‐Z|steamメーカー別GPU使用率

競合企業(AMD、Googleなど)の動向と対策

NVIDIAの強力な市場地位に対抗する形で、他の企業もAIハードウェア市場への参入を積極的に進めています。特に注目すべきはAMDとGoogleの動向です。

AMDは、GPU市場でのNVIDIAのシェアに挑戦するべく、自社のGPU製品「Radeon」シリーズを強化しています。AMDは、コストパフォーマンスに優れた製品を提供することで、価格に敏感な中小企業やスタートアップ企業をターゲットにしています。また、オープンソースのプラットフォームであるROCm(Radeon Open Compute)を提供することで、開発者コミュニティとの連携を強化し、柔軟なAI開発環境を提供しています。

一方、Googleは、自社のAI専用ハードウェア「TPU(Tensor Processing Unit)」を開発・提供しています。TPUは、特にGoogleのクラウドサービスと連携して動作するよう設計されており、クラウドベースのAI開発を強力にサポートしています。Googleは、TPUを通じて大規模なデータセンターでのAI処理を効率化し、クラウド上でのスケーラブルなAIソリューションを提供しています。

これらの競合企業は、NVIDIAに対抗するために技術革新とコスト削減に注力しています。例えば、AMDは次世代GPUの開発において、より高い性能と低い電力消費を実現するための新素材やアーキテクチャを採用しています。Googleも、TPUの性能向上とともに、クラウドサービスの最適化を進めることで、ユーザーにとって魅力的なAIハードウェアソリューションを提供しています。

NVIDIAの強みと弱み

NVIDIAは、AIハードウェア市場において多くの強みを持っていますが、一方でいくつかの弱点も存在します。

強み:

-

技術力とイノベーション

NVIDIAは、GPU技術のリーダーとして常に最先端の技術を追求しています。H100シリーズをはじめとする最新GPUは、高い計算性能とエネルギー効率を実現しており、AI開発者からの信頼を得ています。 -

CUDAプラットフォーム

NVIDIAのCUDAは、開発者がGPUの並列処理能力を最大限に活用できるよう設計されたプラットフォームです。これにより、NVIDIAのGPUはAI開発の標準ツールとして広く認識されており、開発者コミュニティでの支持も厚いです。 -

エコシステムの構築

NVIDIAは、ソフトウェア開発者、研究者、企業との連携を強化し、AIエコシステム全体を構築しています。このエコシステムにより、NVIDIAの技術はさまざまな産業分野で広く利用され、AI技術の普及と発展を支援しています。

弱み:

-

高コスト

前述の通り、NVIDIAの高性能GPUは非常に高価であり、特に中小企業にとっては導入が難しい場合があります。この高コストは、初期投資の大きさだけでなく、運用コストの増加にもつながります。 -

製造依存

NVIDIAは、GPUの製造をTSMCなどのファウンドリ企業に委託しています。このため、製造プロセスにおける外部要因(例: サプライチェーンの遅延、製造技術の制約など)に影響を受けやすいです。 -

競争の激化

AMDやGoogleなどの競合企業がAIハードウェア市場に積極的に参入することで、NVIDIAの市場シェアは徐々に脅かされています。特にコストパフォーマンスやクラウド連携において、競合他社が強力なソリューションを提供しているため、NVIDIAはこれらの競争に対抗するための戦略的な対応が求められています。

5. 安全かつ効率的なローカルアクセスのためのおすすめソリューション

ローカル環境でのAI活用を支えるセキュリティの重要性

製造業におけるAI活用が進む中、ローカル環境でのデータ処理やAIモデルの運用には高いセキュリティが求められます。特に、企業の重要な知的財産や機密情報を扱う場合、外部からの不正アクセスやデータ漏洩のリスクを最小限に抑えることが不可欠です。安全なアクセス環境を整えることは、AIプロジェクトの成功に直結します。

Splashtop Secure Workspace の導入メリット

そこでおすすめなのが、Splashtop Secure Workspace(SSW) です。このソリューションは、安全かつ効率的にローカル環境へアクセスできるため、製造業におけるAI活用を強力にサポートします。以下に、その主なメリットをご紹介します。

-

高度なセキュリティ機能

・AES-256ビット暗号化やTLSプロトコルを採用し、データの安全性を確保。

・多要素認証(MFA)により、不正アクセスを防止。 -

リモートアクセスの効率化

・高速な接続速度と低遅延を実現し、快適なリモート操作を提供。

・マルチデバイス対応で、どこからでも容易にアクセス可能。 -

統合管理と監視

・一元管理コンソールにより、ユーザーのアクセス状況をリアルタイムで監視。

・詳細なログ記録機能で、セキュリティインシデントの追跡が容易。

さくらインターネットとの連携で実現する安全なAI環境

さくらインターネットとSplashtop Secure Workspace を組み合わせることで、さらに強固なAI活用環境を構築できます。さくらインターネットの高信頼性なクラウドサービスと連携し、データのバックアップや災害対策も万全です。これにより、製造業におけるAIプロジェクトの信頼性と安定性が大幅に向上します。

具体的な連携のメリット

- データの冗長性確保:さくらインターネットのクラウドにデータをバックアップすることで、万一の障害時にも迅速な復旧が可能。

- スケーラブルなリソース管理:AIモデルのトレーニングや推論に必要な計算リソースを柔軟に拡張・縮小できる。

- 一貫したセキュリティポリシー:両サービスが提供するセキュリティ機能を統合的に管理し、全体のセキュリティレベルを向上。

Splashtop Secure Workspace の具体的な活用方法

Splashtop Secure Workspace は、以下のような具体的な活用シナリオで効果を発揮します。

-

AIモデルのローカルトレーニング

高性能なNVIDIA GPUを搭載したローカルサーバーでAIモデルをトレーニングし、セキュアにリモートからアクセス。データの安全な管理と迅速な開発が可能です。 -

リアルタイムのデータ分析

製造ラインから収集したデータをリアルタイムで分析し、即時のフィードバックを提供。Splashtop Secure Workspaceを通じて、どこからでも安全にアクセスできるため、迅速な意思決定が可能です。 -

遠隔地からのメンテナンスとサポート

専門技術者が遠隔地から機器のメンテナンスやサポートを行う際に、セキュアな環境でアクセスできるため、現場のダウンタイムを最小限に抑えることができます。

まとめと導入のすすめ

NVIDIAのAIハードウェアとファウンデーションモデルを活用することで、製造業はさらなる効率化と競争力の向上を実現できます。しかし、安全かつ効率的にローカル環境へアクセスするためには、Splashtop Secure Workspace の導入が不可欠です。このソリューションは、高度なセキュリティ機能とリモートアクセスの利便性を兼ね備えており、製造業におけるAI活用を強力にサポートします。

さくらインターネット とSplashtop Secure Workspace の連携により、安心してAIプロジェクトを推進できる環境を手に入れましょう。今こそ、最先端のAI技術と安全なアクセス環境を整えることで、製造業の未来を切り拓く一歩を踏み出してください。